Lluis Codina | lluis.codina@upf.edu

Universitat Pompeu Fabra, España

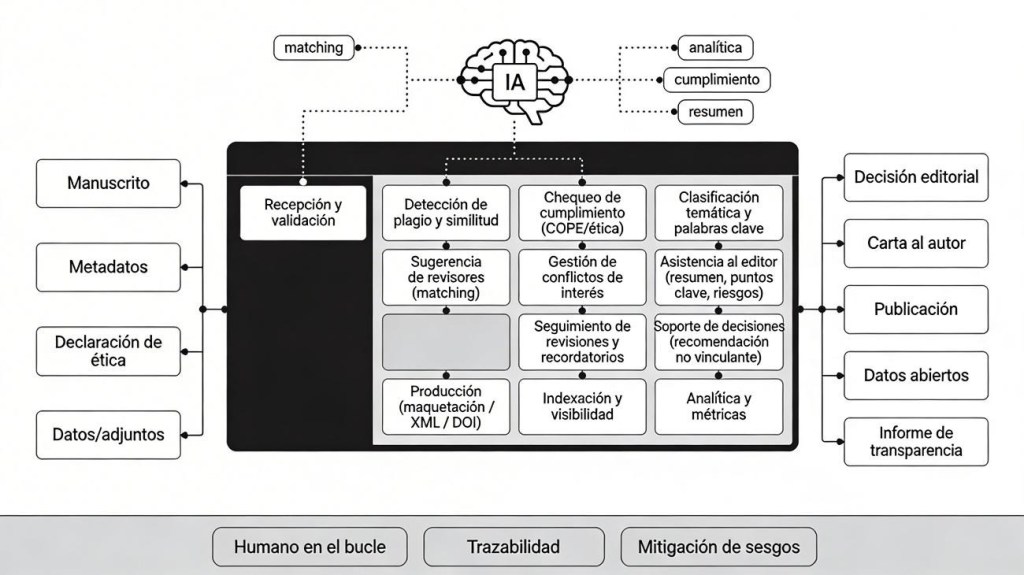

Figura 1. La IA en la gestión de revistas. Imagen generada por Perplexity con el prompt: “Haz una ilustración tipo wireframe para ilustrar el uso de la IA en la gestión de revistas científicas” [Por si acaso, no se lo tomen la ilustración al pie de la letra].

Las gestión de las revistas científicas es anti intuitivamente compleja. Me temo que la mayoría de los académicos que nunca han tenido responsabilidades de gestión en una revista creen, como dijo una persona en redes una vez, “que se limitan a tomar los manuscritos y publicarlos en la web”.

No me voy a detener a considerar esta visión extremadamente naif. Solo quiero señalar la distancia que hay entre la complejidad real de la gestión de una revista científica, y la complejidad percibida por la propia comunidad académica. Me gustaría que nuestros colegas académicos fueran mas conscientes de esta realidad. “Y a mí me gustaría tener un yate”, pensará el lector O sea, que, ¿esto a qué viene?

Se debe a que “se viene” aún más complejidad. La causa (¿cómo no?) es la inteligencia artificial. No es ninguna novedad, pero a medida que su uso se extiende los problemas crecen para las revistas, y la necesidad de afrontarlos mediante protocolos bien establecidos, aumenta.

Zonas grises

Primero, las revistas científicas necesitan que las normativas confluyan, ya que ahora hay divergencias importantes entre ellas. Segundo, necesitamos que se vaya generando una cultura común que permita tratar con seguridad las diferentes casuísticas imposibles de prever incluso si algún día tenemos normativas unificadas.

Lo cierto es que hay unos pocos puntos bien establecidos al respecto. Entre ellos, que las IA no pueden ser acreditadas como autoras y su contraparte, a saber, que los autores (humanos) retienen toda la responsabilidad. También tenemos el punto que exige transparencia en el uso de la IA.

Pero más allá de esto, hay zonas grises. La más amplia es la que necesita distribuir la necesidad de transparencia entre usos con declaración obligatoria, usos con declaración opcional, y usos que no es necesario declarar. Además, hay una zona de contradicción en los usos prohibidos.

Voy a poner un ejemplo. Veo en algunas guías principios como este: “debe declararse obligatoriamente cuando una sección del artículo ha sido redactada total o parcialmente por una IA”.

¿Ven la contradicción? Si el punto número 1 dice que las IA no pueden ser autoras, y el número 2 dice que el humano retiene toda la responsabilidad, ¿porqué se acepta implícitamente que algunas secciones las redacte la IA? Esto no debería depender de una declaración. Por el contrario, por aplicación de los puntos 1 y 2 usar la IA para redactar secciones de un artículo debería ser un uso expresamente prohibido. Y la declaración no puede redimir esta prohibición. Sería como decir, “con tal que se declare, esta permitido plagiar”.

¿Agilizar las evaluaciones con la IA?

Otro frente es el uso de la inteligencia artificial por parte de los evaluadores. Aquí también tenemos un punto con casi total unanimidad. Las cinco principales editoriales científicas del mundo (Elsevier, Springer Nature, Wiley, Taylor and Francis, Sage) prohíben taxativamente que sus evaluadores usen la IA.

Las razones son dos: en primer lugar, se considera una dejación de responsabilidad confiar en el juicio de una IA, ya que carece de conciencia. En segundo lugar, se contravienen principios de protección de datos, de confidencialidad y de derechos de autor, porque la IA podría usar datos del manuscrito en sus respuestas a otros usuarios.

Sin embargo esto crea una tensión esencial. Se supone que la IA debería ayudar a agilizar procesos. Esto por un lado. Por otro, a la vista de las evaluaciones que uno recibe a veces, se hecha a faltar que una IA hubiera tomado la decisión, seguro que hubiera sido más objetiva. Disculpen la broma fácil.

Lo cierto es que, el posible uso de la IA en la evaluación de los manuscritos podría aportar un alivio importante a la carga de gestión de las revistas. Sin embargo, los dos motivos que aconsejan la prohibición de subir artículos a las IA son muy potentes y no pueden soslayarse.

La prohibición, por tanto es sólida y llena de sentido. Mi duda aquí es la siguiente: ¿seria imaginable un escenario en el que las revistas sin ceder el control a las IA y sin vulnerar la protección de datos, aprovechen la ventaja de usar la IA para agilizar las evaluaciones? Tal vez la respuesta es no. Pero tal vez sea un sí.

Si no se explora este camino no lo sabremos nunca. Por si acaso, y para evitar malentendidos: lo único que podemos decir por ahora es que la IA no debe ser usada para evaluar manuscritos. Que quede claro. Pero seguiremos explorando este territorio porque seguro que vale la pena.

El autor

Lluís Codina es profesor honorario e investigador de la Universitat Pompeu Fabra. Desde la aparición de ChatGPT ha desarrollado una labor investigadora y divulgadora del uso de la inteligencia artificial en la academia y en el periodismo. Muchas de sus publicaciones pueden seguirse en su sitio web personal: lluiscodina.com

Deja un comentario